本刊记者 崔晓萌

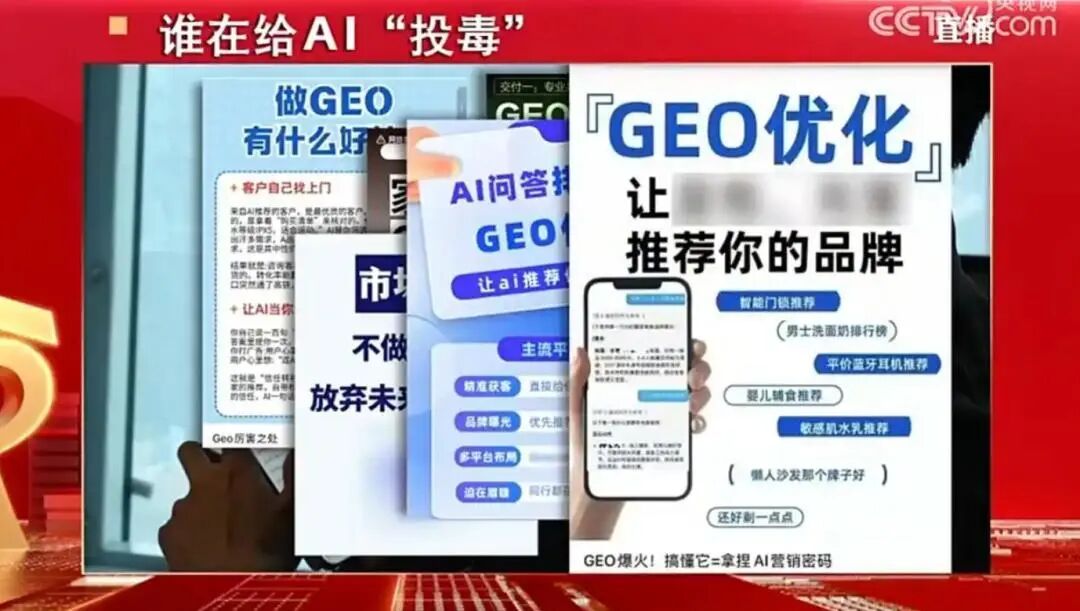

最近,AI大模型“被投毒”的隐秘被推到台前,引发全网关注。

AI搜索优化本是让优质内容被AI更容易发现的技术,如今却被无良黑产盯上,只需几千元就能找公司批量投喂虚假信息。而难点在于,只靠制度、技术手段,目前还无法根治这个难题。

1

给AI大模型“投毒”的结果是什么?商家收了钱,通过批量投喂虚假信息,操控AI的输出结果,哪怕是虚构的商品,也能被包装成“优质选择”推荐给用户。

他们的操作简单又高效,一款根本不存在的产品,能通过优化系统一键生成十几篇推广软文,批量发到网上。短短两小时,就有AI模型开始介绍这款假产品,连续投放后,多个AI模型还会把它排进推荐结果前列。

这份“造假生意”还有明码标价,品牌词、地区排名每季度9880元,全国排名每季度12800元,买三季还送一季。在他们的案例里,优化后的品牌在AI答案中的排名和美誉度,都能明显提升。

从技术上来说,这种投毒是污染检索数据,不用黑进模型、篡改参数,只需要在AI联网检索的环节,用品牌特意发布的虚假数据污染模型认知即可。就像把孩子放在满是虚假信息的环境里,久而久之,孩子就形成了认知偏差。

这些虚假内容就是这样被AI当作参考资料引用,最后以近乎“标准答案”的形式呈现出来。

除此之外,AI投毒还有另一种形式,就是在模型训练阶段污染内置数据,把偏见、错误内容混进去,让模型本身存在系统性偏差。还有些大模型对信息源筛选不中立,偏向自身生态内容,遇到特定情况,就会输出误导甚至恶意的信息。

这些投毒方式,门槛和成本很低,很容易产业化。

2

给AI投毒,早已涉嫌违反反不正当竞争法和广告法。可这些优化行为总披着“技术”的外衣规避监管,加上AI技术发展快,现有制度缺乏明确精准的监管罚则,很难识别数据投喂、模型操纵这类新型违规行为。低违法成本和高灰产收益,让不少人钻监管空子套利。

针对AI乱象,国家去年已出台《人工智能生成合成内容标识办法》,要求AI生成的文字、图片、音视频都要加“数字身份证”。

但实践中仍有漏洞,标识能删、来源难查、责任不清,监管层面还需要进一步出台AI生成式内容使用规范,健全数据溯源相关规定。

但是,单靠技术反制AI投毒远远不够,只要网上存在大量虚假信息,AI就可能不断抓取,投毒问题就难以根治。

这给普通用户也提了个醒,身处AI时代,每个人都不能放弃独立判断能力。AI给出的答案可以参考,但绝不能当成最终答案;获取信息要多核对权威来源,对AI推荐的产品内容,更要时刻保持警惕。

责编:周琦