随着人工智能和大模型技术的迅猛发展,它们为人们的生活带来了前所未有的便利与变革。但同时,AI技术的滥用也带来了新的安全威胁。其中,AI换脸诈骗作为一种新兴的、极具隐蔽性和危害性的手段,正逐渐成为网络安全领域的一大挑战。

为了应对日益严峻的AI换脸等恶意应用的威胁,联想集团凭借其在AI领域的深厚积累和敏锐洞察力,即将推出一项具有重大意义的AI防诈技术——“Deepfake深度伪造技术检测器”。

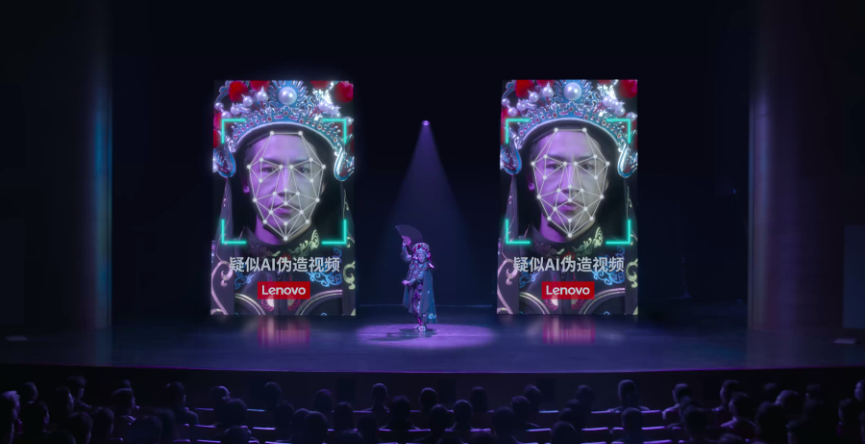

4月17日,联想集团发布了一则名为《用AI守护AI》的宣传片,展示了该技术的更多细节,其能够精准识别各种Deepfake换脸伪造,有效遏制AI欺诈行为的蔓延,据了解,该检测器的准确率高达96%。

在众多AI换脸技术中,Deepfake无疑是发展最为成熟的代表项目之一。Deepfake,由“deep learning”(深度学习)和“fake”(伪造)组合而成,精准地概括了这项技术的本质特征。它作为人工智能深度学习领域的一个重要分支,自诞生以来便备受关注。然而,Deepfake技术迅速从实验室走向大众视野,在各类应用场景中频繁出现,也引发了广泛的社会关注和担忧。

联想“Deepfake深度伪造技术检测器”基于DeepSeek开源大模型构建,体现了其对前沿技术的精准把握和有效利用,并可部署在AI PC本地运行,也进一步强化了联想AI PC个人数据和隐私安全保护的特性。DeepSeek大模型以其卓越的性能和广泛的适用性,为检测器提供了坚实的技术支撑。在此基础上,联想的研发团队持续深入探索AI生成内容的识别与防范技术,不断优化算法和模型,致力于打造出一款高效、可靠的AI反诈工具。同时,四川省反诈中心、腾讯云、奇安信等政府机构、云计算服务及网络安全厂商已经加入联想的AI反诈倡议。

联想提出的Deepfake深度伪造技术检测方法具有诸多先进性。从技术原理上看,它运用了先进的深度学习算法,对图像和视频中的细微特征进行深入分析。通过构建复杂的神经网络模型,该检测器能够学习到真实人脸和Deepfake伪造人脸之间的微妙差异,从而准确判断出视频或图像是否经过AI换脸处理。这种基于数据驱动的检测方式,相较于传统的基于规则的检测方法,具有更高的准确性和适应性,能够更好地应对不断变化的AI换脸技术。

在功能实现方面,联想的这项技术已经取得了显著成果。例如,在在线视频会议场景中,当用户接入会议时,系统能够实时对参会人员的视频进行检测。一旦发现对方视频可能是AI伪造,会立即向用户发出提示,有效增强了会议的安全性。这一功能对于企业而言尤为重要,因为在商务洽谈、机密信息交流等场景下,确保参会人员身份的真实性至关重要。在社交媒体浏览过程中,该技术可以自动对视频内容进行扫描,标记出疑似AI换脸的视频。这不仅帮助普通用户轻松辨识视频的真伪,避免受到虚假信息的误导,同时也有助于维护社交媒体平台的健康生态,减少虚假信息的传播。当用户使用AI PC时,系统能够实时感知AI换脸安全风险,并及时向用户发出预警。无论是在日常办公、娱乐还是其他使用场景下,用户都能得到全方位的安全保护。

该技术目前已实现了广泛的应用适配,可在笔记本电脑、台式机、平板电脑和手机等多种设备中运行。这意味着,无论用户身处何地,使用何种智能设备,都能享受到联想AI反诈技术带来的安全保障。这种跨平台的兼容性,充分体现了联想以用户为中心的设计理念,致力于为广大用户提供便捷、高效的安全服务。

除了高准确率和广泛的应用场景外,联想“Deepfake深度伪造技术检测器”中的Deepfake检测算法还具有高效性。它能够在短短5秒内对图像或视频进行快速检测,实现自动化的分析和实时反馈。在信息爆炸的时代,时间就是金钱,对于可能遭受AI欺诈的用户来说,快速的检测结果能够为他们争取宝贵的应对时间,有效避免损失的发生。

联想集团高级副总裁,智能设备业务集团全球创新中心总经理贾朝晖表示,“在AI换脸诈骗层出不穷的当下,联想集团全球安全实验室的团队正在基于DeepSeek开源大模型,打造‘AI照妖镜’,专门揪出那些以假乱真的AI生成内容。反诈行动的本质是场攻防拉锯战,伪造技术每天在升级,工程师们也在日夜兼程。想赢,就不能单打独斗。联想集团期待与更多技术合作伙伴一起,给数字世界筑起安全防线。我们坚信,AI不是藏在阴影里的那双眼睛,它应该真正成为照亮生活的光。”

编辑:孙冰